10. pi0.5:开放世界与分层执行

先修建议

- 已完成第 9 讲

π₀,理解VLM + Action Expert + Flow Matching的基础骨架。 - 熟悉 action chunking、交叉熵训练与 flow matching 基本概念。

- 对“训练配方影响泛化”有基本直觉。

本节目标

- 理解

π₀.5为什么采用“先生成子任务文本,再生成低层动作”的两层分解。 - 看懂

MM/ME/CE/HL/WD/VI六类数据如何在两阶段训练中协同。 - 对齐论文中的关键训练与评测口径,避免把演示效果误读为普适结论。

- 建立与后续第 11 讲

RTC、第 12 讲π₀.6的连续认知链路。

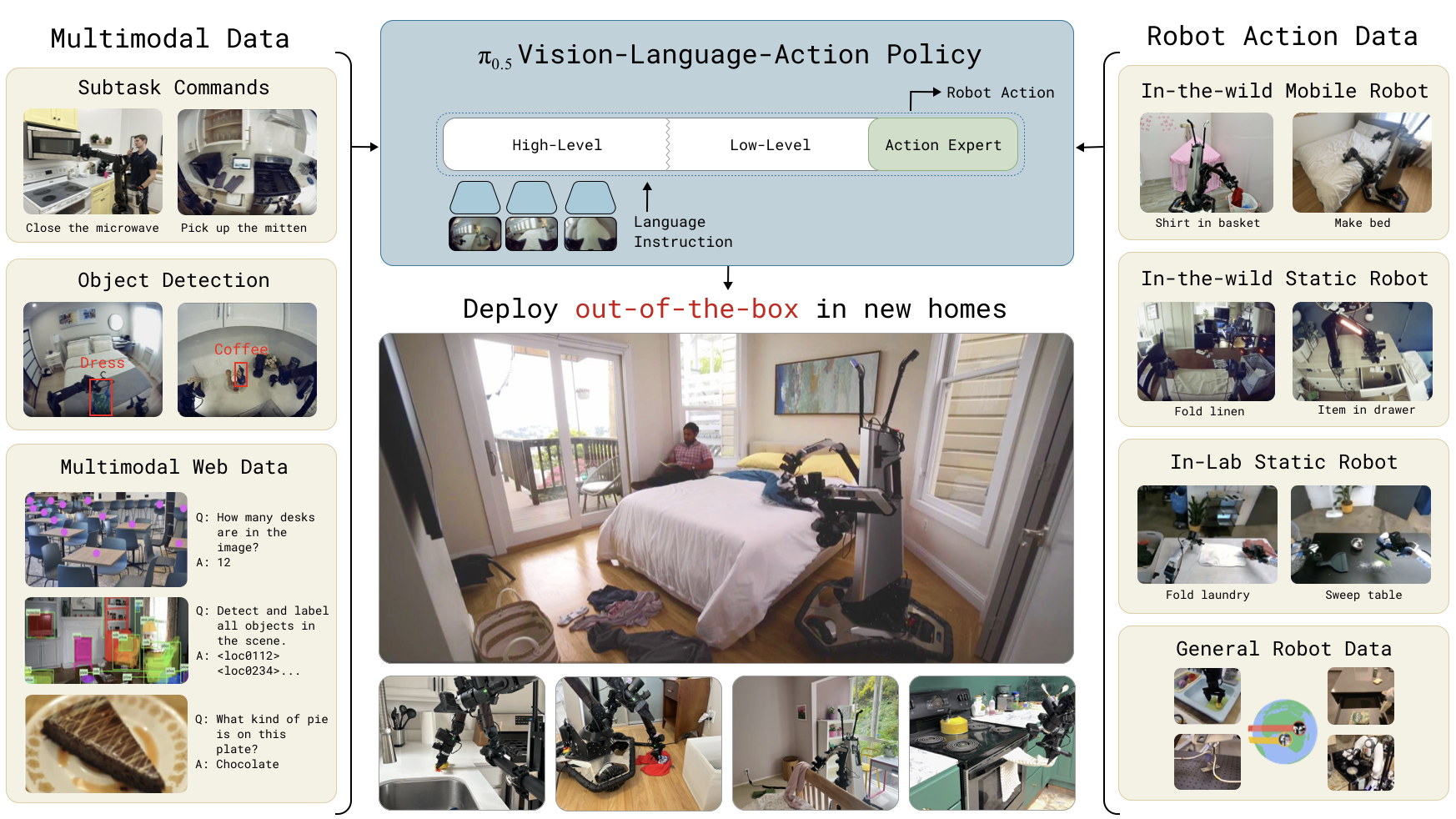

读图重点:这张 teaser 要看的是“训练外家庭 + 长程任务”这两个条件同时成立。

1. 为什么 pi0.5 要“先说再做”

承接句:π₀ 把跨机体动作建模做成了可复用基础骨架,但核心评测仍以实验室及近分布场景为主;π₀.5 把目标前移到训练外真实家庭中的多阶段任务。

π₀.5 针对的是一个更现实的问题:当机器人进入陌生家庭时,任务难点不只来自动作执行,还来自语义决策。

同一个“clean the kitchen”高层指令,系统需要先回答三类问题:

- 当前场景下下一步应做哪一个子任务。

- 这个子任务对应的对象与空间关系是什么。

- 低层动作如何在当前机体约束下稳定完成。

论文给出的整体策略是三件事协同:

- 用层级子任务推理把“做什么”与“怎么做”分离。

- 用异构数据共训扩充视觉语义与任务先验来源。

- 用信息单向流动降低连续动作损失对语言语义路径的干扰。

需要区分两个时长口径:

- 开篇强调的是可达

10-15分钟级别的长程行为能力。 - 主体量化评测里,多数标准任务段落在

2-5分钟区间。

这两组数字对应不同实验语境,不应混写成单一结论。

2. 两层策略分解:先预测子任务,再解码动作块

承接句:π₀ 的主形式是“任务文本 -> 动作块”;π₀.5 在中间显式插入了可解释的子任务文本层。

论文把联合分布写为:

关键约束是:低层动作分布不直接条件于原始高层指令

| 符号 | 含义 |

|---|---|

| 当前观测(多相机图像 + 本体状态) | |

| 高层任务指令(如“整理厨房”) | |

| 子任务文本(如“pick up the plate”) | |

| 连续动作块 | |

| 动作 horizon(附录给出 |

把中间变量设计成离散文本 token而非连续 latent,有两个直接收益:

- 与 VLM 预训练词表与交叉熵监督天然兼容。

- 子任务可读、可控,便于调试与人类指令介入。

这一步构成了本章最关键的“先说再做”:先生成可解释子任务,再进入连续控制。

3. 五路数据如何共训成一个策略

承接句:π₀ 主要扩展了跨机体动作覆盖;π₀.5 在此基础上把高层语义监督与 Web 知识显式纳入训练配方。

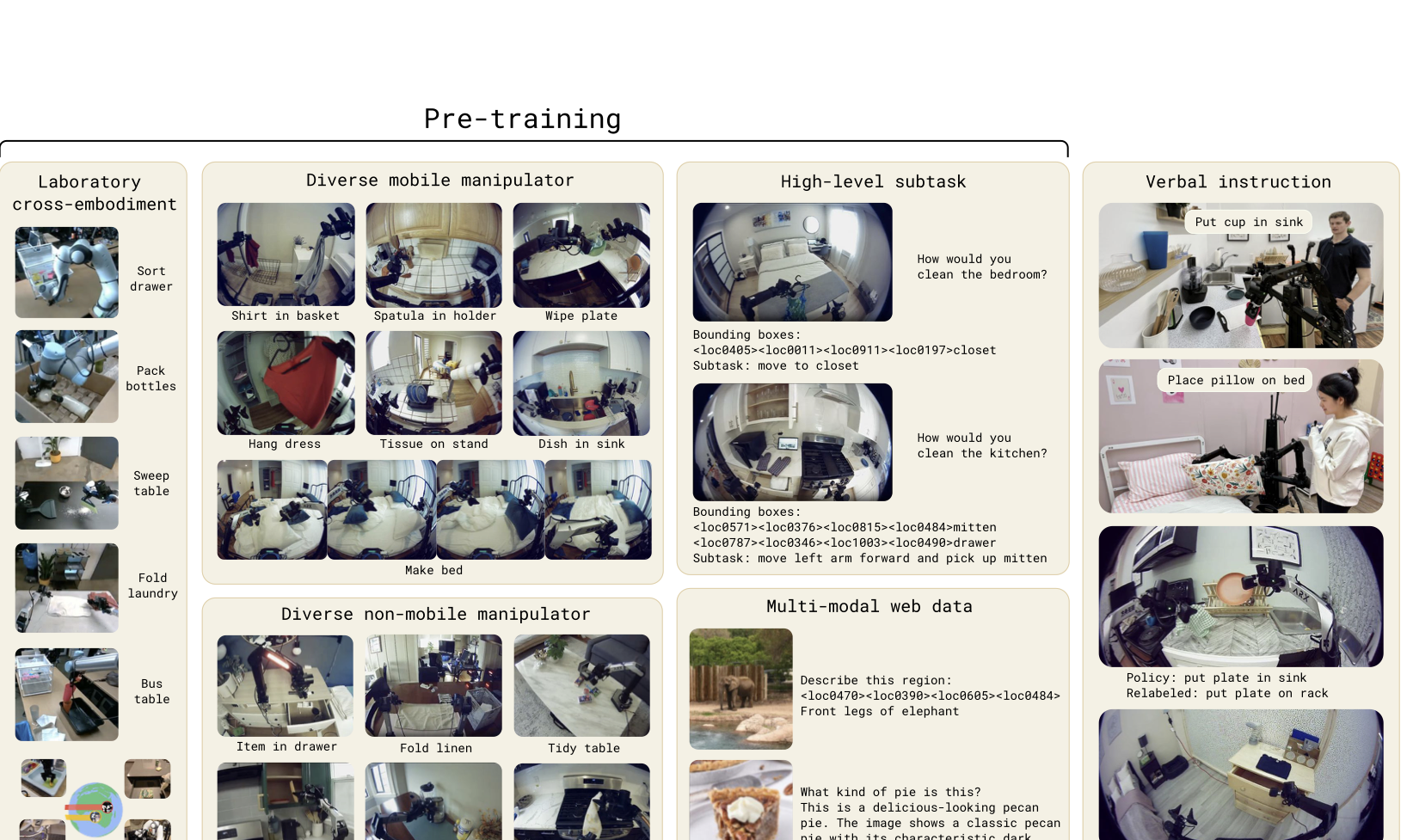

读图重点:这张图要看“同一模型、两阶段训练、数据源角色变化”。

3.1 预训练阶段(pre-training)

预训练同时使用以下数据源:

MM:移动操作数据(约 400 小时,约 100 个家庭环境)。ME:多环境非移动操作数据。CE:实验室跨机体数据(含 OXE)。HL:高层子任务文本与相关标注。WD:Web 多模态数据(captioning / VQA / detection)。

论文主文给出关键比例:第一阶段中约 97.6% 的样本并非来自移动操作本体数据,而来自其他来源(其他机器人、Web 等)。

3.2 后训练阶段(post-training)

后训练聚焦移动场景,保留 MM/ME/HL/WD,并加入:

VI:verbal instruction 语言示教数据。

同时移除 CE,将训练重心从“广覆盖适配”转向“移动操作专精”。

3.3 数据对齐细节

为保证多源机器人数据可拼接训练,论文明确了动作侧的统一处理:

- 各数据集动作维度按分位数归一化到

[-1, 1]。 - 维度不足的机体使用 zero-padding 对齐。

- 控制模态通过文本标记显式写入 prompt。

这也是“异构数据能否真正共训”的工程基础。

4. FAST+Flow 双通道:离散语义与连续动作并存

承接句:主骨架仍延续 π₀,但 π₀.5 把离散 token 路径与连续动作路径的协作关系写得更完整。

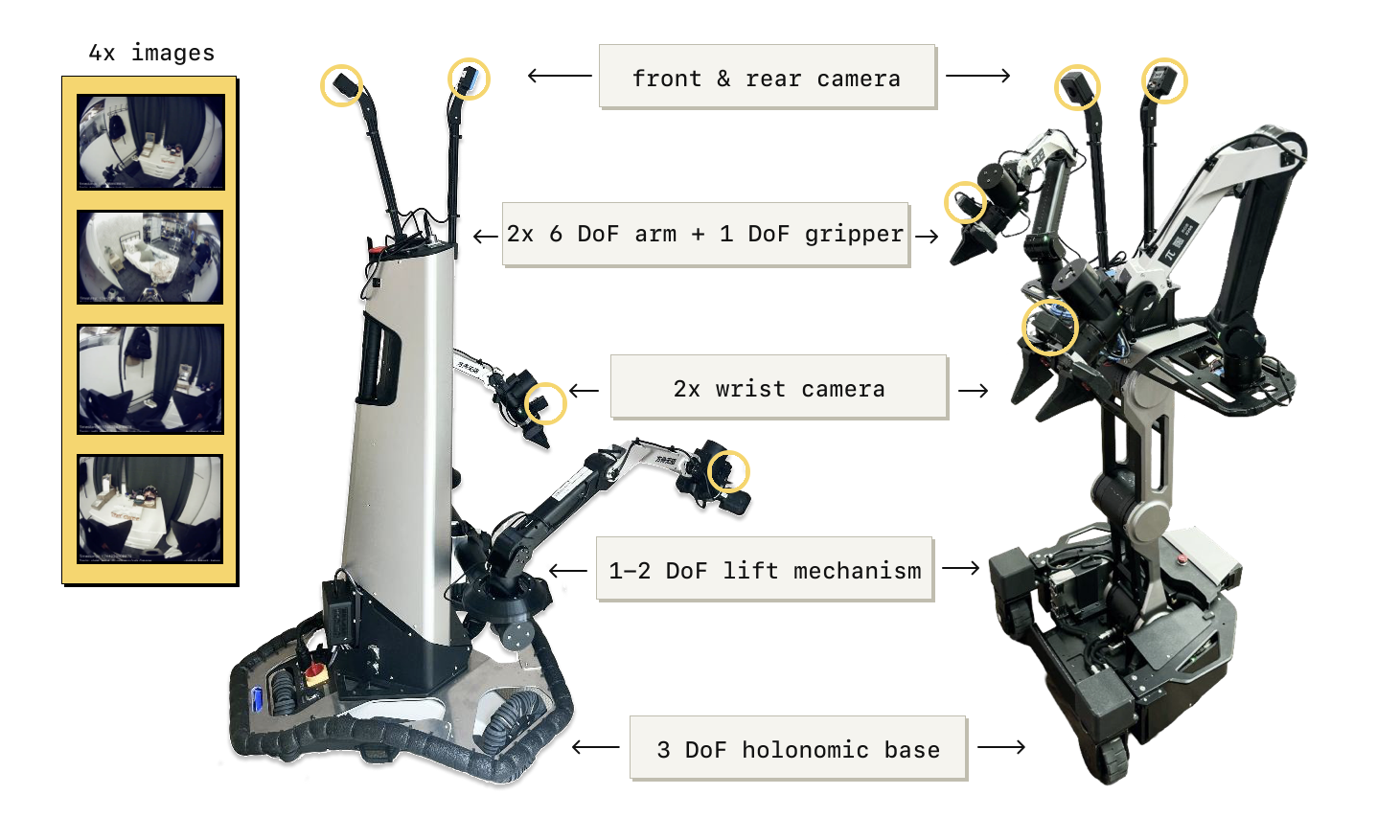

读图重点:这张系统图主要看传感器与动作空间规模,不只看外观形态。

架构层可以概括为三层:

- 共享 VLM 主干负责多模态语义表示与文本输出。

- 文本输出路径负责生成高层子任务与其他离散 token 目标。

- Action Expert 路径负责 flow matching 连续动作生成。

论文附录给出两项关键结构口径:

- 主干为 PaliGemma 系列初始化(2B 级别设置)。

- Action Expert 为较小独立专家(约 300M 量级配置)。

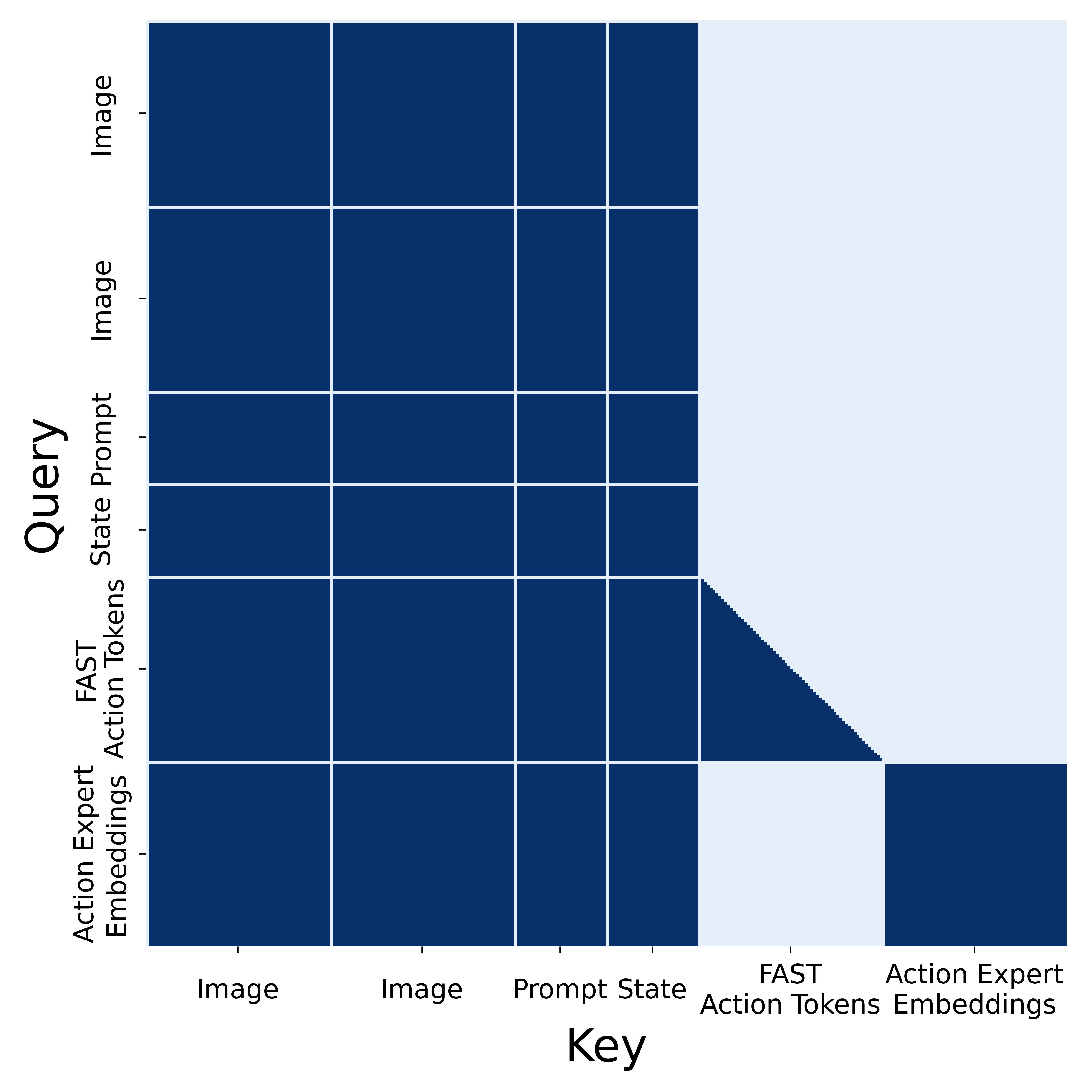

读图重点:mask 图要看“谁能看谁”,尤其是动作专家与 FAST token 的隔离关系。

论文附录的核心规则是:

- 动作专家可 attend 到 prefix 与自身动作专家 token。

- 动作专家不 attend FAST 动作 token(避免两种动作表示互相泄漏)。

- VLM token 不 attend 动作专家。

这使连续动作梯度对语言语义主路径的干扰被显式限制。

5. 两阶段训练:先对齐语义,再专精控制

承接句:π₀.5 沿用 π₀ 的 flow matching 控制路线,但把训练目标扩展为离散与连续联合优化。

论文给出的联合目标可写为:

其中第一项是文本/离散 token 路径交叉熵,第二项是连续动作 flow matching 损失。

5.1 阶段切换口径

- pre-training:

α=0,以离散 token 学习为主。 - post-training:

α=10.0,加入连续动作专家训练。

训练步数口径:

- pre-training:

280ksteps - post-training:

80ksteps

动作专家在 post 阶段以随机初始化接入,同时保留 next-token 训练以维持文本能力。

5.2 与推理接口的对应

论文主文给出的推理描述是:

- 先做文本自回归解码得到子任务文本。

- 再做

10次 denoising 得到连续动作块。

这构成了“训练目标分解”与“推理执行分解”的一一对应。

6. 从子任务文本到 50Hz 控制闭环

承接句:π₀.5 在能力上向开放世界推进,但系统层仍然受到动作块推理与执行时延约束;这正是第 11 讲 RTC 要继续解决的问题。

运行时闭环可以按四步理解:

- 输入观测与高层指令,生成子任务文本。

- 以子任务文本为条件,生成动作块。

- 控制器按底层频率执行目标。

- 新观测到来后重复上述过程。

与部署强相关的论文口径:

- 平台使用四路相机做高层推理。

- 低层推理使用腕部与前视等关键视角。

- 控制目标以

50Hz由 PD 控制器跟踪。 - 动作块 horizon 为 50 步(附录写为

H=49token 索引)。

关于“高层更新频率”,论文主文未给统一固定值;更稳妥的写法是“按任务阶段切换动态重采样”,避免硬编码成某个单一频率口径。

7. 开放世界证据链:新家庭、扩场景、看消融

承接句:相较 π₀ 的实验室与近分布泛化证据,π₀.5 的核心推进是把评测主战场放到训练外真实家庭。

7.1 新家庭量化评测

读图重点:先看三类任务在不同真实家庭中的一致性,再看是否与 mock 评测趋势一致。

论文设置要点:

- 评测在训练未出现的真实家庭进行。

- 任务覆盖厨房与卧室清理子任务。

- 标准量化任务多为

2-5分钟多阶段流程。

7.2 场景数量 scaling

论文把训练位置数分为 3 / 12 / 22 / 53 / 82 / 104 桶进行对比。

读图重点:重点看“训练位置增加 -> 语言跟随与成功率同步上升”,尤其是 OOD 对象趋势。

主文还给出一个关键语境:104-location 模型在部分设定下可接近“直接在测试家庭训练”的对照表现,但该结论应限定在文中指定协议与任务集合下解读。

7.3 训练配方与高层推理消融

高层相关消融显示:

- 完整

π₀.5表现最好。 implicit HL(训练有 HL、推理不显式 HL)通常显著优于no HL。- 去掉

VI或WD都会明显退化高层表现。

读图重点:比较 full / implicit HL / no HL / no VI / no WD / GPT-4 / human HL 的相对差距,而不是只看单个柱。

论文同时指出:VI 仅占高层移动操作样本约 11%,但对最终高层策略质量有关键影响。

8. 失败模式、能力边界与下一讲入口

承接句:π₀.5 的核心贡献是“能在训练外家庭泛化执行”;但它仍然不是“可实时无损闭环 + 可在线持续学习”的终点形态。

论文 Discussion 明确给出的边界包括:

- 某些物理结构(如陌生把手)仍易失败。

- 部分可观测性导致关键状态被遮挡。

- 高层子任务推理可能出现分心或重复行为。

这意味着 π₀.5 的下一步不应只理解为“再加数据”,还包括两条系统路线:

- 实时执行路线:如何在高延迟与复杂控制条件下保持稳定闭环(第 11 讲

RTC)。 - 在线学习路线:如何把部署期经验回流为策略更新,而非仅靠离线再训练(第 12 讲

π₀.6)。

把 π 系列压缩成一条主线可写成:

π₀(跨机体基座) -> π₀.5(跨场景泛化) -> RTC(实时执行优化) -> π₀.6(在线经验学习)。